Golpistas usam IA para criar imitações de vozes idênticas

O uso de deepfakes por golpistas tem crescido de forma alarmante no Japão, conforme indicam dados do setor privado. Essa tecnologia, que gera vídeos, fotos ou áudios manipulados digitalmente para parecerem reais, está permitindo que criminosos contornem a barreira linguística, aumentando a vulnerabilidade do país a fraudes.

Segundo a Sumsub, uma empresa britânica especializada em verificação de identidade, o número de casos de deepfake no Japão cresceu 28 vezes no ano passado. Esse aumento foi o quinto maior entre 224 economias analisadas. Nos primeiros três meses deste ano, os golpes no país subiram 243% em relação ao mesmo período de 2023, embora a empresa não tenha divulgado o número exato de incidentes.

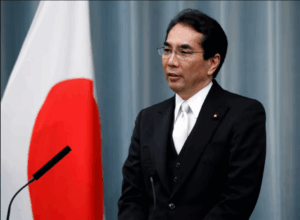

Um exemplo que ilustra a crescente sofisticação dos golpes ocorreu em novembro do ano passado, quando um vídeo falso circulou nas redes sociais japonesas. Usando imagens alteradas de um telejornal real, o vídeo incentivava os espectadores a se cadastrarem em um site de investimentos fraudulentos.

Historicamente, o Japão tinha uma baixa taxa de sucesso em golpes financeiros, em parte devido à dificuldade de dominar a língua japonesa. No entanto, com o avanço da inteligência artificial (IA) generativa, é possível criar conteúdos em japonês com fluência quase nativa, eliminando essa barreira para organizações criminosas internacionais.

Além dos deepfakes em vídeo, a IA também está sendo usada para criar golpes baseados em textos. No ano passado, o Japão registrou o maior aumento no número de empresas que relataram receber e-mails de phishing, de acordo com a empresa de cibersegurança norte-americana Proofpoint. A empresa britânica de análises Elliptic identificou ferramentas à venda no aplicativo de mensagens Telegram que permitem criar mensagens de áudio artificiais em diversos idiomas. Embora disponíveis para compra, o nível de precisão dessas ferramentas ainda é incerto.

Os golpes utilizando deepfakes já geraram grandes prejuízos. Em fevereiro deste ano, um funcionário de uma empresa multinacional de engenharia no Reino Unido foi enganado e transferiu 200 milhões de dólares de Hong Kong (US$ 25,6 milhões) da empresa para golpistas após participar de uma videochamada falsa.

Um alto funcionário da polícia japonesa alertou que ainda não está claro até que ponto os deepfakes estão sendo usados em golpes no Japão, mas destacou a possibilidade de que esses métodos se tornem ainda mais sofisticados. Em resposta a essa ameaça crescente, o Instituto Nacional de Informática de Tóquio lançou, no ano passado, um programa capaz de detectar se uma imagem facial é um deepfake. Grupos financeiros estão adotando essa tecnologia para prevenir fraudes de identidade. O instituto também planeja lançar, ainda este ano, uma versão do programa capaz de identificar deepfakes em áudios.

O professor Junichi Yamagishi, do Instituto Nacional de Informática, também expressou preocupação com as chamadas telefônicas fraudulentas que utilizam áudio artificial para imitar a voz de parentes das vítimas. Ele destacou a necessidade de desenvolver maneiras para que dispositivos comuns possam detectar essas chamadas no futuro.

Fonte: Mainichi